要说这几天最大的新闻,当属是美国、以色列和伊朗的这篓子事了。

关于地缘政治和军事冲突的博弈,差评君不是专家,就不在这里班门弄斧了。但值得注意的是,随着远方炮火声一同在互联网上引爆的,还有一波大家对 AI 参战的深深恐惧。

这两天,一篇把 AI在战场上描绘得神乎其神的文章在各个群里炸开了锅,获得了病毒式的传播。

文章链接我就不贴了,简单摘要两句话来给大家一起看吧:

在那篇文章里,这场被美军命名为“史诗愤怒行动”的斩首突袭,被认为是 “它是人类历史上第一次由人工智能(AI)多轮辅助“杀伤链”(Kill Chain)的高层斩首行动”。

还说 “AI不再只是一个辅助工具,它与人类一起成了真正的决策者、追踪者和执行者的一部分。”

这些词一套一套的,看起来是蛮唬人的,仿佛下一秒,AI 就能独立发起一场战争,像科幻电影一下直接把大家给一起突突了得了。

但是在仔细阅读了各类主流媒体的报道,扒拉了不少 AI 圈的通告后,差评君发现这篇文章不能说是稍微夸大,只能说是基本扯蛋了。

今天咱们就不妨从现实出发,好好盘一盘:在这次的军事行动中,AI 到底起到了什么作用?它又是怎么起作用的?

美国政府在军队中使用 AI,是大家早就知道的了的事情。

早在 24 年 11 月,Anthropic 和一家为美国军方提供大数据分析的公司 Palantir 就展开了合作,整上了个特殊的服务器,在里面运行上了政府定制版的 Claude。

到了去年 6 月,Anthropic 更是直接写了篇博客,告诉大家他们给政府特调了一个模型,Claude Gov。

比起传统的 Claude 来说,这个政府特供模型直接打开了话匣子,可以处理各种敏感信息。

而且还能精通各路方言,看起来是没少吃当年温州话加密通讯的亏啊。。。

好了,没了,目前网络上,能比较靠谱的讲出 AI在这次军事行动中起到了什么作用的内容,其实就这些。

至于剩下的那些“AI 自动锁头”、“一键发射导弹”的地摊文学,大家当个乐子看就行, 除非有现场怪出来现身说法,否则都不太靠谱。

大家也能看出来,在真实的战争机器里,大模型扮演的,主要还是一个情报官和分析师的工作。

现代战场的数据简直就是个无底洞,天上的卫星图、前线的无人机视野、雷达信号,飞机路径,甚至是刚才提到的各种方言和加密电波都混在一起,以前想要处理这么多信息就得纯纯靠人工。靠一屋子的情报分析师熬大夜去一帧一帧地扒、一句一句地听才行。

而参与信息处理的人一多,那信息在传递的过程中可能就会有遗漏,但现在接上了大模型之后,几十万字的情报直接往 Claude 里一扔,刷刷过几秒钟,可能大模型的判断结果就出来了。

在差评君看来,根据公开实锤的资料,这套操作背后的逻辑,甚至和你平时遇到麻烦,去问大模型法律条款、或者让它帮你总结一下体检报告,本质上差不多。

最大的差别,无非就是他们喂给 AI的知识库,以及训练的数据,换成了实打实的机密情报和战争模型而已。

它给出来的信息能不能信,能信多少,还得依靠人类来做最后的判断。

总不可能直接问克劳德,“小克小克,帮我找到对面老大的位置”,就直接按下开火键吧。

当然,我们也不能小看判断信息的作用。

实际上,就这么个把信息总结,信息决策能力点满了的 AI ,已经早就是美国军方的心头好了。

为此,美国军方还跟 Anthropic 大打出手。

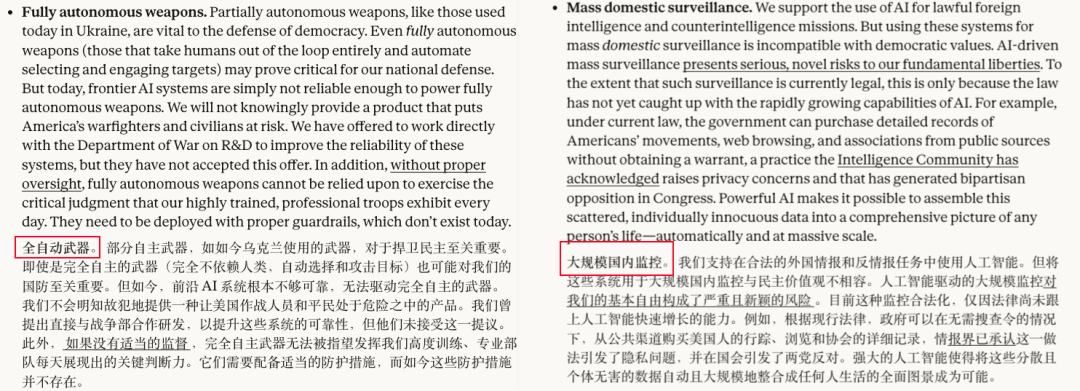

在 Anthonpic 眼里,它认为 AI 可以给拿去用作军事用途,但是不能乱用,于是他们给 AI 划了两条红线:

一是要求禁止军方把 AI拿去大规模的监控美国民众,二是不能拿 AI 来开发完全自主的杀戮武器。

说完这俩话 Anthropic 还打了个补丁,说现在 AI 还没做到这些事,这俩红线只是放在未来以防万一的。

但是在美国军方眼里,这种行为简直就是典型的“你在教我做事”。战争机器的运转,怎么可能受制于一家私营企业的服务条款?

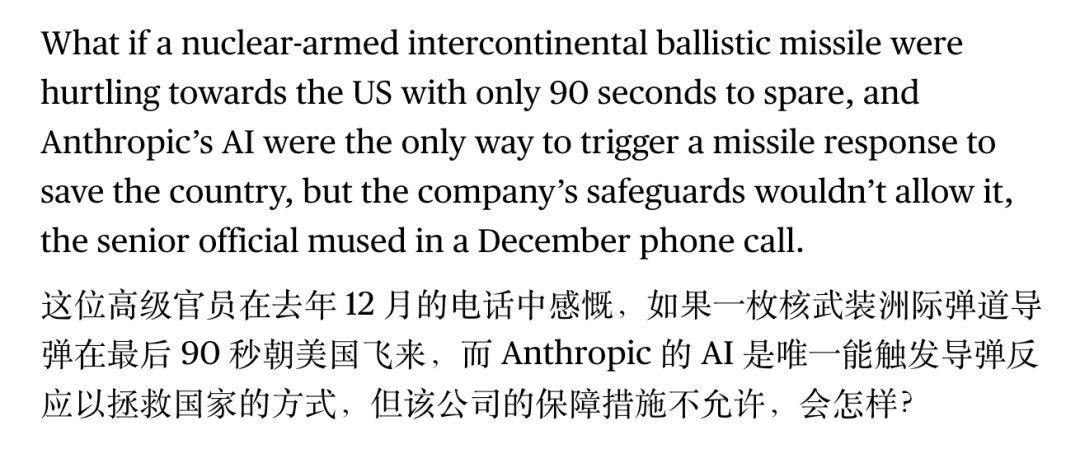

根据彭博社的报道,去年 12 月的时候,一个美国国防官员就问过 Anthropic 的 CEO 达里奥 一个假设问题:

如果一枚装载着核弹头的洲际导弹正朝着美国本土砸来,离落地只剩下最后的 90 秒。

而这个时候,Anthropic 的 AI 是全村唯一的希望,是唯一能触发反击系统、拯救整个国家的手段。但偏偏,由于你们公司设置的安全护栏不允许,AI 死活拒绝执行发射命令,这时候该怎么办?

结果达里奥的回答给军方直接给干沉默了,简单而有力的两个字:“Call me”。

好家伙,合着国家面临生死存亡、只剩一分半钟就要被核平的危机关头,超级大国的总统和将军们还得先找个手机,给你这位私企老板打电话走个审批流程?

这对军队来说,属于是完全不能接受的结果了。

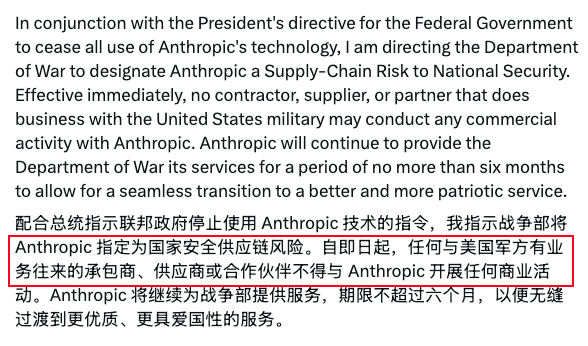

于是,五角大楼也是彻底掀桌子了,要求 Anthropic 开放毫无保留的 AI 最终控制权。在遭到拒绝后,美国政府立刻展开了排山倒海般的施压。

这场拉扯持续了数月之久,官方不仅在谈判桌上步步紧逼,最终甚至直接动用了国家机器的力量。

达里奥也从那个阳光开朗大男孩,变成了一副苦大仇深的样子。

就在几天前,特朗普总统亲自下达了极其严厉的禁令,要求所有联邦机构立刻停止与 Anthropic 的合作。

紧接着,美国国防部更是直接翻脸,将这家前脚还在帮他们处理机密情报的美国公司,正式定性为国家安全供应链风险,要求凡与美国军方有业务往来的承包商、供应商或合作伙伴,均不得与Anthropic开展任何商业活动。。。

如果这玩意真的执行下去,那 Anthropic 可能都找不到更多服务器来训练新模型了。

但好玩的是,其实美国政府自己也舍不得 Claude,虽然嘴上喊着要全面封杀,但身体却无比诚实,留下了六个月的缓冲期,在几天后对伊朗的军事行动里,还是口嫌体正直的用上了 Claude。

而山姆奥特曼的 OpenAI、马斯克的 XAI 看到 Claude 的退出,也开始抓住这波机会,想要让自己的公司来和美国军方展开合作。

所以说,不论硅谷的公司们如何争论,AI 越来越多地介入现代战争,已经是一个不可逆转的必然趋势。

在体验过 Claude 之后,美国军方已经彻底回不去了。就算被特朗普列入管制名单,他们还依旧保留了 6 个月的过渡时间来让自己继续用 Claude。

不可否认,AI 必然会对未来的军事甚至世界格局产生巨大的影响。但越是在这种时候,我们越需要正视这种影响,褪去那些科幻电影和网络爽文带来的恐惧滤镜。

只有建立起理性的认知,弄清楚现在的 AI到底能干嘛,不能干嘛,我们才不会轻易被那些瞎编扯淡的“赛博地摊文学”给忽悠了,陷入莫名其妙的恐慌和焦虑。

这种恐慌和焦虑,或许是比 AI 更可怕的东西。

撰文:早起

编辑:江江 & 面线 & 大饼

美编:焕妍

图片、资料来源:

X,网络信息

US military reportedly used Claude in Iran strikes despite Trump’s ban

Inside Anthropic’s Killer-Robot Dispute With the Pentagon

U.S. Strikes in Middle East Use Anthropic, Hours After Trump Ban

Pentagon Used Anthropic’s Claude in Maduro Venezuela Raid

Anthropic and Palantir Partner to Bring Claude AI Models to AWS for U.S. Government Intelligence and Defense Operations

Read the full tran of our interview with Anthropic CEO Dario Amodei

Anthropic faces fallout across federal agencies from DOD clash

Responsible AI that meets government needs

Claude Gov models for U.S. national security customers